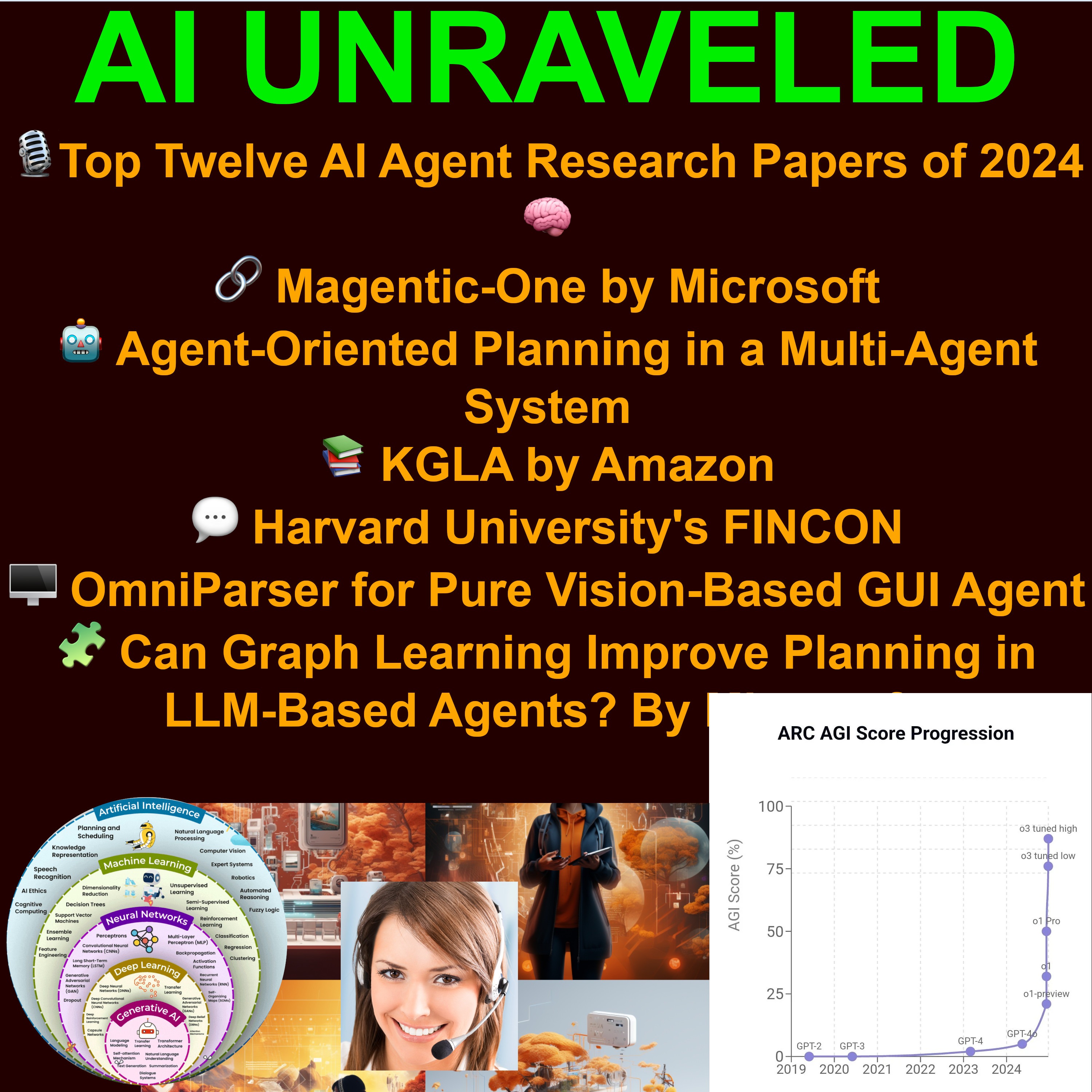

🧩Top Twelve AI Agent Research Papers of 2024🐞

AI Unraveled: Latest AI News & Trends, GPT, ChatGPT, Gemini, Generative AI, LLMs, Prompting

Deep Dive

What is the significance of Microsoft's Magentic-One in AI agent research?

Magentic-One is a multi-agent system designed to handle web-based and file-based tasks across various domains. It uses specialized AI agents that collaborate to achieve larger goals, such as research, data analysis, and report generation, showcasing the power of collective intelligence in AI systems.

How does Amazon's KGLA framework enhance AI agents' capabilities?

Amazon's KGLA framework integrates knowledge graphs, allowing AI agents to access vast networks of facts and relationships. This enables them to reason, make connections, and solve problems more effectively, such as providing personalized customer support or identifying financial risks.

What is the focus of Harvard University's FinCon research?

FinCon explores how AI agents can learn through simulated financial conversations, refining their understanding of financial markets and strategies. This conversational verbal reinforcement allows AI agents to develop financial intuition and adapt to complex scenarios.

What makes OmniParser a groundbreaking development in AI agent research?

OmniParser enables AI agents to navigate graphical user interfaces (GUIs) using only visual cues, allowing them to interact with software similarly to humans. This adaptability eliminates the need for explicit programming for each new interface, making AI agents more flexible and efficient.

How does graph learning improve planning in AI agents, as shown in Microsoft's research?

Graph learning allows AI agents to interpret visual representations of relationships, helping them grasp complex connections and make strategic decisions. This approach enables agents to analyze the bigger picture and develop nuanced plans of action in dynamic environments.

What is the significance of Stanford and Google DeepMind's research on simulating 1,000 people's vocal patterns?

This research demonstrates AI's ability to generate realistic human voices, enabling applications like natural-sounding virtual assistants, lifelike simulations for training, and personalized learning experiences. It also raises ethical questions about the use of such technology.

How does ByteDance's research on LLM-based agents impact software development?

ByteDance's research compares large language models (LLMs) for automated bug fixing, aiming to streamline development, reduce human error, and improve software quality. AI agents can identify and fix bugs automatically, allowing developers to focus on higher-level tasks.

Why does sparse communication topology improve multi-agent debate, according to Google DeepMind?

Sparse communication limits direct interaction between agents, reducing noise and confusion. This structured approach allows agents to present clear, evidence-based arguments, leading to more focused and insightful debates, which is crucial for collaborative problem-solving.

What are the key takeaways from OpenAI's paper on governing agentic AI systems?

OpenAI emphasizes the importance of transparency, accountability, and robust oversight mechanisms to ensure AI agents operate safely and ethically. The paper highlights the need for clear guidelines and multidisciplinary collaboration to align AI systems with human values.

How does Anthropic's Sonnet 3.5 case study demonstrate advancements in AI agent usability?

Sonnet 3.5 showcases an AI system that interacts with computer interfaces intuitively, similar to how humans would. This focus on user-friendliness and accessibility makes AI agents more approachable for non-technical users, bridging the gap between human intuition and machine capabilities.

What are the potential economic impacts of AI agents on the workforce?

While AI agents may automate some jobs, they also create new opportunities in human-AI collaboration, critical thinking, and creativity. Historical technological advancements, like the internet, show that disruption often leads to new industries and professions, requiring adaptation and upskilling.

Why is explainable AI (XAI) crucial for the future of AI agents?

Explainable AI ensures that AI agents can provide transparent reasoning for their decisions, fostering trust and accountability. This is especially important for critical tasks like financial decision-making, medical diagnosis, and autonomous vehicle control, where understanding the decision process is essential.

- AI agents are like specialized digital assistants.

- They work together and learn from each other.

- Collaborative aspect drives advancements.

Shownotes Transcript

好的,让我们深入了解AI代理的世界。你们发来了大量关于最新突破的研究论文,我们将尝试解开其中真正重要的内容。这次深入研究的任务是什么?我想我们的目标是让大家了解2024年AI代理技术,并尝试理解其潜在的连锁反应。

是的,真正有趣的是研究人员采用的方法的多样性。他们正在处理从基本的自动化任务到复杂的金融建模,甚至使用AI代理模拟整个社会环境等各种问题。好的,在我们深入了解细节之前,让我们确保我们都在同一页上。将AI代理想象成高度专业化的数字助理,每个助理都拥有自己的一套技能。但它们不是去取咖啡,而是处理数据,在复杂的系统中导航。

甚至通过对话学习以变得更有效。是的,这里的关键是这些AI代理不仅仅是孤立的程序。它们被设计成一起工作并相互学习。正是这种协作性推动了一些最令人兴奋的进步。对。这不仅仅是关于个体才华,而是集体智慧。

说到协作,微软关于Magentic One的论文确实引起了我的注意。他们构建了一个系统,可以无缝处理大量基于网络和文件的任务。是的,Magentic One是多代理系统运行的绝佳示例。有趣的是,他们是如何创建专门的AI代理来协作以实现更大目标的。例如,你可能有一个擅长研究的代理,另一个擅长数据分析的代理。

还有一个可以生成报告或演示文稿的代理。- 所以这就像有一支梦想团队的AI专家在幕后工作。这与关于多代理系统中面向代理的规划的论文很好地结合在一起,对吧?- 绝对正确,是的。这项研究深入探讨了这些代理如何有效地协调他们的工作。

他们提出了一种元代理架构,其中一种超级代理充当指挥者,协调各个代理以确保每个人都在同步工作。所以这就像管理一个复杂的项目。但我们不是人类团队成员,而是这些专门的代理。我正在尝试想象一下。这是否类似于无人机机群的工作方式?

每个无人机都有自己的任务,例如拾取包裹或导航到交付点。但它们都由中央系统协调。这是一个很好的类比。在这种情况下,元代理就像那个中央控制系统,优化路线,管理交通,并确保整个操作顺利运行。但使这个概念更强大的是知识的整合。

这就是亚马逊的KGLA研究的关键所在。他们正在讨论让AI代理访问庞大的知识图谱。因此,这些代理基本上可以利用庞大的事实和关系网络。没错。这是一个改变游戏规则的方法,因为它允许AI代理以以前无法实现的方式进行推理和建立联系。这就像赋予他们对不同信息片段之间关系的深刻理解,就像侦探破案一样。因此,这些代理不是盲目地遵循指令,而是可以分析信息,推断结论,甚至提出创造性的解决方案。这非常强大。绝对的。想象一下由KGLA支持的客户支持代理。它可以立即访问包含产品信息、客户历史记录、故障排除指南的知识图谱。

等等。这意味着更准确、更个性化和更高效的支持。或者考虑一下财务建模。拥有访问全面知识图谱的AI代理可能会发现人类可能错过的模式和风险。嗯,可能性令人难以置信。

说到学习,哈佛大学关于FinCon的论文确实引起了我的兴趣。他们正在探索AI代理如何通过对话学习,尤其是在金融领域。是的。FinCon引入了会话语言强化这个概念,这基本上意味着AI代理参与模拟金融对话以完善他们的理解和策略。这就像让一群金融专家集思广益并讨论不同的场景。

但你不是人类,而是这些不断学习和适应的AI代理。所以这不仅仅是关于计算数字。而是通过对话来理解金融市场的细微之处。这就像他们通过对话发展自己的金融直觉。这非常吸引人。现在,稍微改变一下方向,OmniParser的研究怎么样?它似乎专注于只能使用视觉线索来导航图形用户界面的AI代理。

这项研究是创造能够以类似于人类的方式与软件交互的AI代理的重要一步。想象一下一个AI代理,它可以通过简单地观察人类如何使用它来学习使用任何软件,而不是通过明确的编程。因此,这些代理可能不会局限于特定任务,而是可以适应任何软件环境。

这打开了一些非常有趣的机会。想想一下自动化我们都讨厌的那些重复性任务,或者改善残疾用户的可访问性。我们甚至可以使用这些代理进行可用性测试,看看真实用户如何与软件交互。你抓住了重点。OmniParser的基于视觉的方法具有开创性,因为它允许AI代理具有极强的适应性。他们不需要为遇到的每个新界面进行明确的编程。

这是在灵活性和效率方面的一次巨大飞跃。但这不仅仅是关于视觉线索,对吧?微软关于图学习的研究强调了如何在规划方面使AI代理变得更聪明。你完全正确。通过教AI代理解释图表,我们基本上给了他们关系的视觉表示。这使他们能够掌握复杂的联系并做出更具战略性的决策。因此,他们不是盲目地遵循一组指令,

这些代理可以着眼于更大的图景,分析任务或数据点之间的关系,并制定更细致的行动计划。这似乎是任何在动态环境中运行的AI代理的强大工具。正是如此。这就像给他们一张问题空间的地图,让他们不仅看到单个任务,还看到整体格局以及一切如何连接。这很有趣。现在,我们一直在讨论AI代理执行任务,但它们沟通和互动能力如何呢?

斯坦福大学谷歌DeepMind关于模拟1000人的语音模式的论文确实引起了我的注意。是的,这项研究展示了AI在生成逼真的人声方面的令人难以置信的进步。想象一下一个世界,虚拟助理的声音完全自然,或者……或者……

或者能够为培训甚至娱乐创建极其逼真的模拟。这就像我们正在模糊人类和机器交流之间的界限。这既令人兴奋又有点令人不安,你不会这么认为吗?它确实提出了一些,你知道的,有趣的问题。但让我们暂时关注潜在的好处。

想想这项技术如何彻底改变语音界面,使其更自然、更引人入胜。或者考虑它在教育或辅助功能中的用途,创造个性化的学习体验,或为失去声音的人提供声音。这些是一些非常引人注目的应用。但让我们现实一点,也存在潜在的缺点,对吧?当然,当然。与任何强大的技术一样,都存在滥用的可能性。

但这就是为什么尽早进行这些对话如此重要的原因,以预测潜在的挑战并制定保障措施。绝对的。我们需要确保这项技术得到负责任和合乎道德地使用。

现在让我们回到更实际的事情上来。字节跳动关于基于LLM的代理用于自动修复错误的研究对于软件开发人员来说是一个改变游戏规则的方法。是的,这项研究比较了各种大型语言模型,以评估它们自动识别和修复代码中错误的能力。这里的目标是简化开发过程,减少人为错误,

最终创建更强大的软件。因此,开发人员不必花费无数小时调试代码,而是可以将这些AI代理作为幕后工作,在错误甚至成为问题之前就捕获这些讨厌的错误。没错。这可能会对软件质量和可靠性产生巨大影响。想象一下一个软件更新错误更少且更频繁的世界。

因为AI代理在测试和调试方面做了很多繁重的工作。这是一个非常引人注目的愿景。这就像有一支微型代码侦探大军不知疲倦地工作,以确保我们的软件是一流的。研究并没有止步于此。谷歌DeepMind一直在探索如何通过所谓的稀疏通信拓扑来改进多代理辩论。好吧,这听起来很有趣。限制沟通实际上如何提高AI代理之间辩论的质量?

我认为更多的沟通会带来更好的结果。实际上恰恰相反。通过限制直接沟通,他们减少了当太多代理试图同时插话时可能出现的噪音和混乱。这允许进行更集中、更深入的讨论。

代理有空间清晰地陈述他们的论点并用证据支持他们。所以这就像创建一个结构化的辩论格式,每个代理都有机会清晰简洁地陈述自己的观点,而不会被打扰或分心。这说得通。没错。这项研究具有深远的影响。想想事实核查、协作解决问题,甚至理解人类如何辩论和达成共识。

这是关于创造一个理性与证据占主导地位的环境。这是一个非常强大的概念。而且似乎这项研究不仅让我们了解AI代理如何沟通,

也让我们了解我们人类如何更有效地沟通。你说得对。我们可以从研究这些多代理系统中学到很多东西。现在,为了更广泛的视角,让我们看看关于基于LLM的多代理系统的调查论文。它很好地概述了这些系统是如何发展以及它们在现实世界中的各种应用。所以这就像AI代理未来的路线图。

突出关键突破、研究仍在进行的领域,甚至可能是一些即将面临的挑战。没错。说到挑战,我们不要忘记伦理方面的考虑。OpenAI关于管理代理AI系统的论文为负责任的采用和监督提供了一些宝贵的指导。因此,当我们创建这些功能强大的AI代理时……

我们需要确保它们在符合人类价值观并防范潜在风险的框架内运行。绝对的。这篇论文强调了透明度、问责制和强大的监督机制的重要性。这就像为道路制定一套规则,以确保这些AI代理安全和合乎道德地运行。

现在,在我们更详细地探讨伦理考虑之前,让我们花点时间探索AI代理的进步如何影响现实世界的应用。我认为以Anthropix Sonnet 3.5为特色的案例研究提供了一个很好的起点。他们成功创建了一个AI系统,可以有效地使用计算机界面来完成各种任务。这个案例研究特别有趣的是它强调了用户友好性和直观性。

- SANA 3.5不需要复杂的命令或专门的编程知识。它与计算机界面的交互方式与人类非常相似。

所以这就像他们弥合了人类直觉和机器能力之间的差距。没错。如果我们想看到AI代理更广泛的采用,这一点至关重要。我们需要确保它们易于访问和使用,即使对于那些不精通技术的人也是如此。这是一个很好的观点。但在我们走得太远之前,让我们退一步,考虑一下与将这些强大的AI系统集成到我们的生活中相关的潜在挑战和风险。我们稍后将更详细地探讨这些问题。

AI代理变得越来越复杂和强大,这真是令人惊叹。我们才刚刚开始看到它们对我们生活的各个方面的潜在影响。我知道,对吧?感觉我们正处于一些重大变化的边缘。当我们深入研究这些研究论文时,很明显,AI代理不仅仅是一项技术进步。

它们代表了我们与技术互动方式以及我们与周围世界互动方式的根本转变。你抓住了重点。这不仅仅是关于自动化。而是关于创建可以学习、适应甚至与我们以我们尚未完全掌握的方式进行协作的系统。

从这些论文中得出的一个关键结论是,AI代理与其运行的数字环境之间无缝集成的重要性日益提高。这说得通。如果这些AI代理不断遇到障碍或难以在数字世界中导航,我们不能指望它们有效。这就像期望厨师在没有合适的工具和食材的情况下烹饪美食一样。正是如此。

这就是Omni parser项目等研究如此令人兴奋的原因。通过使AI代理能够仅使用视觉线索来理解和与图形用户界面交互,我们基本上赋予了它们以前无法想象的流畅程度来导航数字世界。这就像他们正在学习通过人类的眼睛看待数字世界,理解我们认为理所当然的那些图标、按钮背后的上下文和含义。

和菜单。没错。这打开了一个充满可能性的世界,从自动化复杂任务到改善残疾用户的可访问性,甚至重新设计软件界面使其更直观和用户友好。

所以这不仅仅是让AI代理变得更聪明,而是让数字世界本身更容易访问并适应人类和AI。现在,在我们对用户界面方面过于兴奋之前,让我们回到你之前提到的内容,即AI代理学习和适应的能力。

哈佛大学关于FinCon的论文确实突出了会话学习的潜力,尤其是在金融等复杂领域。是的,FinCon展示了AI代理如何参与模拟对话以完善他们对金融市场的理解并制定更复杂的交易策略。令人着迷的是,这些代理不仅仅是被动地吸收信息,他们还在积极地参与对话,测试他们的假设。

并根据他们收到的反馈来改进他们的策略。所以这就像他们通过对话发展了一种金融直觉,就像人类交易员可能会从他们的导师或同事那里学习一样。

但这些AI代理不是依靠多年的经验,而是可以通过这些模拟对话来加速他们的学习过程。正是如此。这在金融领域之外也具有影响。想象一下,在任何需要复杂决策的领域使用这种方法来训练AI代理。

以及对细微信息的深刻理解。从医疗保健到法律,甚至到写作或音乐等创意领域,可能性是无限的。这真是令人难以置信。这就像我们正在赋予这些AI代理成为各自领域专家的工具,不是通过死记硬背,而是通过动态的、交互式的学习体验。我们不要忘记协作的重要性。

我们已经讨论了Magentic One论文中演示的那种多代理系统如何允许专门的AI代理一起工作以实现复杂的目标。对。这就像组建一支梦想团队的AI专家,每个人都有自己独特的技能和视角。是的。然后让他们无缝地合作来应对挑战。但真正让我印象深刻的是关于稀疏通信拓扑的研究

我最初认为限制代理之间的通信会阻碍他们协作的能力,但事实证明,少即是多。这是一个常见的误解。我们经常认为更多的沟通总是更好。但在从事复杂任务或辩论的AI代理的情况下,过多的沟通实际上可能是有害的。它会导致信息过载、混乱。

以及缺乏重点。所以这就像试图与十几个同时说话的人举行富有成效的会议一样。创建一个结构化的环境,让每个人都有机会清晰而周到地表达自己的想法,会更有效。没错。这就是稀疏通信拓扑力求实现的目标。

通过限制代理之间的直接通信,我们创造了一个环境,让他们可以专注于最重要的信息,制定更合理的论点,并最终得出更准确的结论。这项研究如何挑战我们对沟通和协作的假设,这真是令人着迷。它表明,有时一点策略性的沉默可以带来更深刻的结果。

现在,正如我们所看到的,AI代理在执行任务、从数据中学习甚至参与复杂的沟通方面变得非常熟练。但它们以符合人类价值观和伦理考虑的方式进行推理和决策的能力如何呢?

这是负责任的AI开发的一个关键方面,我们不能忽视它。随着这些AI代理变得更加自主和强大,我们需要确保他们的决策过程是透明的、可问责的,并且符合我们的伦理原则。这就是OpenAI关于管理代理AI系统的论文发挥作用的地方。

对。他们不仅仅专注于让AI代理变得更聪明。他们还在考虑如何有效地管理它们,以确保它们被用于善事,并且不会对人类构成风险。正是如此。OpenAI研究中的一个关键见解是从一开始就建立明确的指导方针和监督机制的重要性。

我们不能等到AI代理完全开发并部署到现实世界中之后才开始考虑伦理影响。所以这就像在我们让自动驾驶汽车在道路上自由行驶之前制定交通法规一样。

我们需要预测潜在的问题,并采取保障措施来防止事故并确保公共安全。这是一个很好的类比。它突出了对AI治理进行多学科方法的必要性。我们需要伦理学家、律师、社会科学家,当然还有AI研究人员一起工作,以创建一个框架,确保这些强大的技术

得到负责任和合乎道德地使用。这听起来像是一个复杂的挑战,但如果我们想在减轻风险的同时充分利用AI代理的潜力,这是一个绝对必要的挑战。

现在,稍微改变一下方向,我想谈谈AI代理对我们经济和劳动力市场的潜在影响。这是一个经常引起很多焦虑的话题,但我认为用平衡的视角来处理它很重要。我同意。随着AI代理变得越来越强大,担心潜在的就业流失是自然的。但同样重要的是要认识到经济增长的新机遇。没错。纵观历史,技术进步往往会导致就业市场发生变化。

但它们也创造了我们以前无法想象的新产业和职业。例如,想想互联网。它扰乱了许多传统产业,但也催生了全新的数字经济,创造了数百万以前不存在的工作岗位。你提出了一个有效的观点。对于AI代理,我们可能会看到类似的模式。虽然一些工作可能会实现自动化,但我们也会看到需要人机协作、批判性思维和创造力的新角色的出现。

所以这并不一定关乎人类与机器。而是关于寻找人类和AI代理有效合作的方法,利用彼此的优势来取得更大的成果。绝对的。这就是教育和技能提升变得至关重要的原因。我们需要为人们提供他们在AI代理日益融入工作场所的未来中蓬勃发展的技能。

这很有道理。与其害怕AI,不如拥抱它带来的机遇,并准备好适应不断变化的环境。现在,当我们深入研究这些研究论文时,我被这样一个事实所震惊,即许多论文不仅专注于使AI代理更强大,

而且还专注于使它们更用户友好和更直观。这是负责任的AI开发中经常被忽视的一个关键方面。仅仅创建强大的AI代理是不够的,我们需要确保它们易于访问和使用,即使对于那些不精通技术的人也是如此。对。这就像设计任何其他工具或技术一样。

如果它太复杂或难以使用,人们就会简单地避免使用它,无论它的功能多么强大。没错。这就是Anthropocene Sonnet 3.5上的案例研究如此重要的原因。通过关注用户友好性和直观的交互,他们正在为一个AI代理可以无缝融入我们生活的未来铺平道路。

而无需我们成为程序员或技术专家。这就像使用带有命令行界面的笨重的旧计算机和使用带有触摸屏和直观应用程序的现代智能手机之间的区别。不。我们希望AI代理像我们最喜欢的移动应用程序一样易于访问和使用。正是如此。随着AI技术的不断进步,我们可以预期对用户体验和可访问性的关注会越来越大。

目标是创建感觉像是我们自身能力的自然延伸的AI代理,这些工具使我们能够比以往任何时候都做得更多、学得更多、取得更多成就。这是一个非常鼓舞人心的愿景。但在我们对可能性过于兴奋之前,让我们花点时间承认将这些强大的AI代理融入我们生活中所带来的潜在挑战和风险。我们稍后将更详细地探讨这些问题。探索AI代理技术的所有这些进步是一段令人着迷的旅程。

在我们结束这次深入研究时,重要的是要承认,虽然潜在的好处是巨大的,但也有一些需要解决的合理担忧。绝对的。我们已经涵盖了从多代理协作和知识整合到会话学习以及围绕这些日益自主的AI系统的所有伦理考虑。

但与任何强大的技术一样,我们需要谨慎行事,并确保这些进步以人类价值观和伦理原则为指导。你抓住了重点。我们面临的最大挑战之一是确保这些AI代理与人类的目标和价值观相一致。仅仅创建高效或有效的AI代理是不够的。我们需要确保它们在一个优先考虑人类福祉、公平性和问责制的框架内运行。对。

这就像教孩子区分对与错一样。我们不能指望代理天生就理解人类的价值观。我们需要通过仔细的设计和开发来灌输这些价值观。没错。这就是OpenAI关于管理代理系统的公开论文如此重要的原因。他们强调需要强大的监督机制、明确的伦理准则。

以及如果AI代理的行为偏离我们的预期目标的能力。所以这不仅仅是关于构建更聪明的AI。而是关于构建我们可以信任的AI。在制衡系统中运行的AI,以防止意外后果。正是如此。这与另一个重要的考虑因素有关,即透明度。

随着AI代理变得越来越复杂,它们的决策过程也变得越来越复杂,至关重要的是,我们能够理解它们是如何得出结论的。

这是一个很好的观点。如果我们无法理解AI代理是如何做出决策的,那么就很难信任它的判断或追究其行为的责任。这就像有一个黑匣子,它会吐出答案,而没有任何关于它是如何得到答案的解释。没错。这就是为什么研究人员越来越关注开发可解释的AI或XAI的原因。目标是创建不仅可以提供答案,还可以以人类可以理解的方式解释其推理的AI系统。

这似乎至关重要,尤其是在我们开始依赖AI代理来完成更复杂和更关键的任务时。无论是做出财务决策、诊断医疗状况,甚至控制自动驾驶汽车,

我们需要知道这些AI代理正在透明和合乎道德地运行。绝对的。我们不要忘记AI代理对我们劳动力和经济的潜在影响。这是一个经常引起很多恐惧和不确定性的主题,但我认为用平衡的视角来处理它很重要。我同意。很容易陷入那些机器人接管所有工作的反乌托邦场景中。

但我认为更现实的做法是将AI代理视为可以增强人类能力并创造新机遇的工具。这是一个很好的表达方式。纵观历史,技术进步往往会导致就业市场发生变化,但它们也创造了我们以前无法想象的新产业和职业。想想印刷机、汽车、计算机。这些发明中的每一个都扰乱了现有产业。

但它们也创造了无数新的工作和机会。我认为AI代理可能会遵循类似的轨迹。你提出了一个有效的观点。虽然一些工作可能会实现自动化,但我们也会看到需要人机协作、批判性思维和创造力的新角色的出现。

关键是适应和发展,拥抱终身学习,并培养在人类和AI并肩工作的未来中将需要的技能。这很有道理。与其害怕AI,不如将其视为增强我们自身能力并创造更繁荣、更公平社会的机遇。绝对的。我认为我们在这次深入研究中探讨的研究让我们对未来的样子有了一瞥。

从可以帮助我们解决复杂问题并加速科学发现的AI代理到可以个性化我们的教育和增强我们创造性努力的AI代理,可能性是无限的。这是一个令人兴奋的时代,你不会这么认为吗?我们正在见证一场技术革命,它有可能以深刻的方式重塑我们的世界。

但当我们拥抱这些进步时,至关重要的是,我们要既充满热情,又保持谨慎。我完全同意。AI的未来并非预先确定的。这是我们通过每一次决策都在积极塑造的东西。确保这些强大的技术被用于善事,创造一个对所有人来说都更公正、更公平、更充实的世界,这是我们共同的责任。说得好。这是一个完美的结束语。感谢您加入我们,深入了解AI代理的世界。我们只是触及了这个迷人领域的表面,但希望我们已经给了你足够多的思考,以便你继续探索。