WTR | 最像人的语音助手;DeepSeek开源周;GPT-4.5发布;小米双Ultra发布会

一周科技回顾 | WTR

Deep Dive

Shownotes Transcript

2025 年 3 月 2 日下午 23 点 10 分欢迎收听最新一期的 WTR 一周科技回顾我是主持人招招我是飙飙我们会在这个节目里面讨论最新最酷最前沿的科技新闻以及我们的数码产品使用心得本周发生了很多 AI 圈的事件让我们一个一个来看

首先是 DeepSeek 本周也像 OpenAI 一样一天发布一个新的玩意儿不过 DeepSeek 这个更加有价值一些它可是开源的它才是 OpenAI 对每天开源一件很有用的工具我觉得也说不上特别有用就

你看它开源的这些东西,基本上都是只有 Hopper 架构的 GPU 才能使用,Hopper 就是 40 系和 40 系的 Ada 架构是同一代的,Hopper 架构数据中心用的卡,有 H100,H800 这些,Hopper 架构的 GPU 才能使用,并且很多是这种大规模集群训练解决这中间的问题。

他第一天开源的是 deep GEMM 这是一个用于 harper 价格 GPU 的高效 F18 局段乘法运算库

然后是 DeepEP 用于这个训练过程中 MOE 专家 B 型通讯还有 DropPipe 这是一个高效计算通讯库用于提高训练时的 GPU 利用率这个库它的效果就是在进行训练的时候那你 GPU 就不会把太多的时间花在等待数据到达上它可以让这个数据的传输和训练的计算同时进行这样就可以提高训练时 GPU 的利用率

还有 ProfiData,这个是 DeepSick V3 和 RE 训练时的数据集的情况,就是他们的这个计算同选交叉的情况,他并没有开放这个数据集,但是开放了这个数据集的相对这些分析数据。

还有 FlashMLA 这是一个用于 Hopper 架构的高效 MLA 计算库这个 MLA 就是 DeepSync V3 和 R1 都用到的 Multi-Head Latent Attention 这种一种 Attention 层用于加速这个的计算 FlashMLA 现在已经被 VLM 去并入了 VLM 的代码库然后可以在你使用 HopperGPU 的时候加速 DeepSync V3 和 R1 的推理

然后 DeepSync 还开源了一个文件系统,可以看到他们这个技术确实很高啊,甚至为了训练这个大模型,还做了一个自己的文件系统叫 3FS,这是一个用于训练过程中推理和训练数据的存储的这么一个分布式网络文件系统。

还有一个叫 small pound 的工具这是基于 DuckDB 和 3FS 的这么一个数据处理框架在第 6 天 DeepSig 还搞了一个 OneMoreThing 介绍了 DeepSig v3 和 R1 的推理基础设施的情况比如说他有提到

在夜间使用的人变少然后硬件的利用率降低他就把一部分节点给抽调出去用来训练他们下一代的模型相当于也是提高他们硬件的利用效率就开源的这些东西你说有用其实还是有用的但是对我有没有用呢或者是对大部分人有没有用呢显然是没有用的因为他们解决的问题

首先都是很多是只有 Howard 架构的 GPU 卡才能用其次都是这种大规模群训练中产生的问题那我首先就没有这么多卡更谈不上这个我根本就没有什么数据需要通讯我只有一个节点哪里需要这个跨界通信的算法呢

感觉是 DeepSeek 炫了一下自己的这些技术储备让外面的人看看自己和其他的这些大模型公司实力上的差距我倒是觉得有一个项目能用得上 DeepSeek 开源的这些东西就是 Hagenweiss 目前在搞的 Open 而已

OpenRE 我看他们现在已经做完了他们计划中的第一步就是用 DeepSeq RE 去训练像千文以及 Lama 这些帧流模型比如用 DeepSeq 的这个帧流数据去训练这个帧流版本的 Lama 还有千文的这些小模型他们现在已经把这个搞完了所以你现在就可以下得到 OpenRE 千文

那接下来下一步他们就要搞真正 R1 的 2L 训练那这 2L 训练中毫无疑问是用得上 DeepThink 这次开源的这些用于大规模进行训练的东西的所以还是有意义的然后说到这个下周阿里巴巴千问团队将会开源千问 QWQ Max 这个也是一个推理模型这种长四边链的推理模型性能我测了测还是挺不错的

哇,感觉现在开源社区变成中国公司在推动发展了还是挺奇妙的那下周,就是千万 QWQ MAX 发布之后我们当然也会在下周的 WTR 去分析这个模型的情况,它的水平

好那么下一个新闻是亚马逊推出了 LM 大圆模型驱动的语音助手 Alexa Plus 亚马逊一直是有做那种智能音箱智能音箱这个品类

亚马逊应该是领先的吧就其他的玩家像什么 Google 的 Nest 然后苹果的 HomePod 这些占领率好像都没有亚马逊来的高对在美国只语音助手就指的是 Alexa 就像国内只语音助手就是天猫精灵一样

对对对这个比以前讲的差不多是这个概念亚马逊这次干了一个狠事就是把 LM 去接到了这个银助手里面你可能会想这有什么稀奇呢现在各家手机厂商都在做但是还不太一样就各家手机厂商比如说你看谷歌做的这个 Google Gemini 它其实和 assistant 助手是两个东西就 assistant 助手可以帮你去控制智能家居然后开关灯这些

但是呢,它没有这个大圆模型问答的能力,而 Gemini 是有这个问答能力,但是它不能帮你去操作这些智能家居,而 Alexa 则是它既可以去回答你的这个复杂问题,也可以帮你去操作这些智能家居,甚至是你描述好你的需求,然后这 Alexa Plus 给你创建智能家居的动画这些。

这个是我在 GBT3.5 刚出来的时候就在想这些手机厂商这些做智能家居的应该就可以直接把 GBT 给接进去那就有一个非常聪明的云助手结果这三年过去了实际做到这一点的厂商是屈指可数像刚刚我看到新闻说这个 LM 版本的 Siri 将会被推迟到 2027 年随着 iOS20 发布

眼睁睁的就要变成下一个 AirPower 了那亚马逊现在这个 Alexa Plus 呢说是三月份也就是这个月就可以开始推送逐步去覆盖到这些 Alexa 设备

并且除了一些特别老旧的 Alexa 设备支持的范围还挺广的我看目前它晒出来的一些实际使用的视频看着确实还是挺不错的希望国内的厂商也能跟进跟进其实我不太清楚现在这些安卓机他们的大模型接入到底是做成什么样子了有没有说也做到了这种可以直接用大圆模型支持的云助手

去正常的云助手能干的事情就操作这些手机之类的想想好像是这个 LLM 的输出其实并不可控虽然它大部分情况下它给出的结果都还不错但是 LLM 最后出来的结果可能最好是要有这些做工程的人员他们应该是知道会有这个 output 的现在是完全不可控

这也是 LM 的优势所在就是强大的泛化性因为你去猜每一个做的时候就考虑每一个 corner case 这是不太现实的用户的数据用户的需求永远是一个无理数你做功能的时候不太可能都考虑得到所以这个结合确实还挺难的然后下一条新闻是 Cloud 3.7 本周发布了

这是一个强化了模型的代码能力的这么一个模型试了一下效果确实非常的好比如说让他设计一个产品的官网他真的做得非常优秀无论是从设计上还是审美上就已经不考虑他代码有没有 bug 了就他完全是给你了一个官网然后排版看起来非常高级就是现代网页的那种样子

甚至还适配了弹性布局你在手机上看不同的尺寸的屏幕都是完全没有问题的这个是有点呛是 Cloud 系列的模型一向就是代码专攻你看现在 Copilot 还有 Cursor 大家主要在用的模型或者说我主要在用的模型就是 Cloud 3.5 之前是 Cloud 3.5 现在换到了 Cloud 3.7 Sonnet

这次也是 Answeropic 终于不负期待推出了这么一个新模型它之前你看 DeepSig R1 出来这么的火这些像谷歌 OpenAI 这些公司都有应对的这些方案只有 Answeropic 是一声不吭这一次终于推出来看起来还真的是卖工出气活

它这个 3.7 Sonnet 也是支持长四维链模式的它这个长四维链的效果还是挺 impressive 它能做到一个什么一点呢就是我让它去写一个代码然后它可以在四维链里面把这个代码写好

然后自己去自动的全自动的在 CV 内面去进行反思说这个代码还有哪个地方可能写的不对哪些地方可能还可以改进然后再写一遍再迭代再改进迭代这么三四遍之后这个代码输出来这个效果就很好了这个是我觉得很 impressive 的一点看现在的那些 benchmark3.7 sonnet 也是在编程这个方面

是目前最领先的尤其是在 LM system 的 chatbot arena 的 web developer leaderboard 上他更是断档领先其他的模型他 1300 多分比第二名的 1200 多分要领先很多第二名也是 cloud 是 cloud3.5 然后下一条新闻是 Inception lab 推出了一个扩散大语言模型用 diffusion 做的大语言模型叫 mercury

然后声称比现在的大圆模型快 10 倍推理速度非常快然后我也试用了一下确实速度要快上不少然后它官网还做了一个 diffusion 的动画我不确定它我觉得它应该不是真的把模型推理的实时过程给你显示出来那样的话要求的网络传输数据量也太大了对我觉得它真正只是个动画不是这个模型真实的推理过程

但是有一点有意思的是它即使是个动画但它还是预先把输出的长度给确定好了因为它输出确实很快在它真正输出完之前它是长度已经固定了然后它再一个一个再的给你这么转换过去 Mercury 我看它声称说是能在 SE100 上达到 1000token 每秒的吞吐量像这样的吞吐量此前是只能在

Grok 这样专用于 LM 推理的专用的计算卡上才能实现的它为什么能做得这么快是因为 Diffusion Model 生成 Token 的原理和自回归的 Transformer 模型不一样 Transformer 模型你得生成一个 Token 之后你再把当前的这些 Token 和此前生成的这些 Token 再重新送入 LM 的 Input 然后再去 Decode 下一个 Token

而 Diffusion Model 你是直接去预测所有的 Token 然后你再去进行几次迭代然后去优化输出的这些 Token 相当于一个是一个一个输出而 Diffusion Model 是一次就输出完了它是整个 Output 去 Decode 这个效率就非常高这周我还看到有一篇新的 paper 叫 Large Language Diffusion Models 写了比较详细的技术报告

就是他训练的时候对这些 token 进行一个 mask 操作然后再用一个 mask predictor 去预测这些被 mask 的 token 这些 mask 是随机分布的然后实际 influence 的时候就先是全部 mask 住去 decode 这些 token 然后再去优化这些 token 这样的输出的效率就很高

只不过缺点就在于虽然速度快但是性能不太行性能跟目前这些领先的 Transform 模型还是有比较大的差距好然后下一条新闻是 OpenAI 发布了 GPT4.5 预览版现在只能给 Plus 用户使用并且 API 也贵得吓人对 SAM 这一次发布 GPT4.5

他没有说性能而是说 4.5 情商很高是不是说的这些回答人类看起来很舒服讲的是说很拟人这个就没法评判了这个倒是也有评判就是他有公布和 4 欧相比人类更偏好哪个的测试测试显示它的 win rate 大概能有 55%60%左右

人类会更偏向于选择 4.5 的输出为什么不提性能呢因为现在是一个推理模型当道的时代无论是 DeepThink RE 还是 Galaxy 3 包括 OpenAI 自家的 O1 还有 O3 Mini 都是推理模型跟这些推理模型一比呢

比如跟 O3 mini high 比起来这个 GBT 4.5 它在很多项目比如说数学还有编码的任务上性能是比 O3 mini 还要低的那你发布一个新的模型性能还不如你上一代的模型这是不是就说不太过去了

不过 GPT4.5 真正比较的对象可能也不是欧三这样的四维链模型和它对比的应该是 GPT4 是和 4 欧比的话还是领先幅度还是比较大的其实这个 SAM 也没有说错就是 4.5 作为一个四维链模型的基础模型可能还是不错的但是你真的要去用的话现在是不如你去用这些四维链模型的毕竟它的价格也非常的昂贵

它的 API 价格达到了非常夸张的输入 75 美元输出 150 美元每板的 Token 这个价格大概达到了 DeepSeek R1 的 300 倍非常的吓人这个价格 GPT4.5 能不能作为像未来的思维链模型的基座呢效果会比较好吗 Sam 就是这么说的实际上我怀疑 O3 就是基于 4.5

去训练的这么一个四位链模型 STEM 现在推出 4.5 可能也是因为最近实在是被其他厂商抢太多分头了 OPI 必须有一个应对措施所以把 4.5 给推出来实际上以 4.5 的表现 OPI 就不应该继续出这种不带四位链的基础模型了应该是直接跳过 4.5 对吧就不出未来直接出 O3

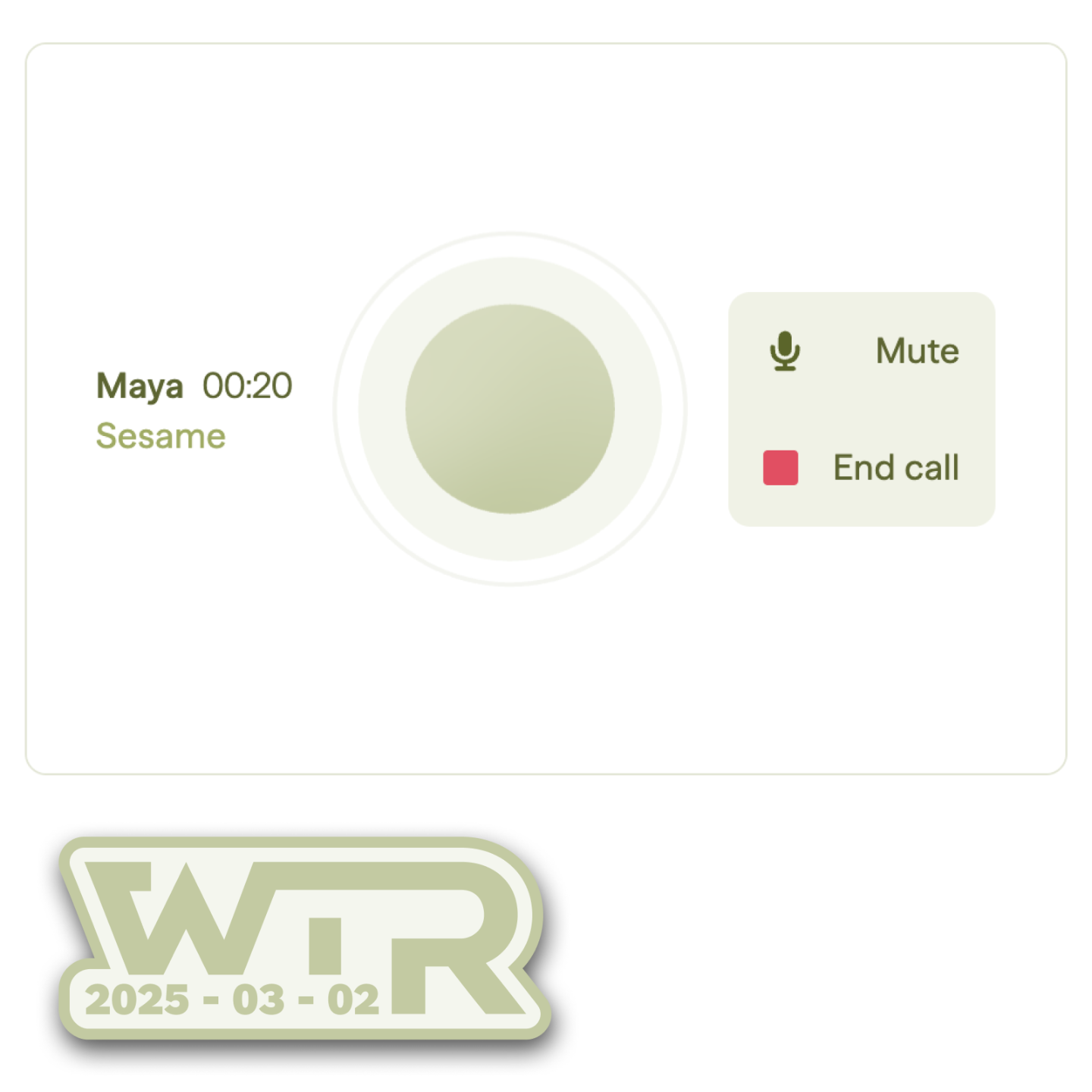

或者是 GPT-5 相当于击沉了这些思维联模型不是发布这么一个高不成低不就的而且还贵得要死的这么一个 GPT-4.5 不禁让我怀疑 OpenAI 的领先幅度也是 GPT-4.5 的消息一出来负面评价还是居多的下一条新闻本周有一个新的实时语音交互的 AI 助手叫 Sesame 效果非常的不错

他的延迟非常低然后说话也非常的像真人我觉得比 OpenAI 的 Advanced Voice Mode 还要好

并且他还有一个神奇的功能是他会主动找话头就是你一段时间不说话之后他会问你你还在吗怎么样怎么样或者说他看你一段时间不回复他觉得你看了你可能对这个话题不感兴趣怎么怎么样我们可以换个话题我刚刚也是的是确实非常的像真人就他说话的这些停顿甚至还有这种叹气声呼吸声

就跟真人几乎没有区别然后说话也很流畅最主要延迟很低就不会说我说完然后他想个一秒钟才回答我这样他延迟超级低对哇这个无敌了比确实比 open air 的高级语音要强 open air 的高级语音我感觉还是很死板的

因为有前面这个 OpenAI 的高级语音模式打底我以为和大模型进行实时语音交互它这个延迟 OpenAI 已经拿出它最大的努力去做了但是一看这个 Sesame 哇这简直不是一个级别的当然我觉得一个原因在于 Sesame 它是一个比较小的模型它最大的一个版本也就 8B

那 OpenAI 的这个 4 欧呢,它可是一个比,我想它可是一个比 8B 大得多的模型,就现在一些报告估计 4 欧的规模可能在万亿左右,当然它可能是一个 MOE 模型,实际的清火参数量没有这么多,但也是比 S3M 要大非常多的,那你模型大了之后,你 pre-fill 的速度就会变慢嘛,

然后相当于想要延迟就 time to first token 这个延迟就会增加这是没有办法的事情其实我觉得这种实时对话也不需要模型有特别好的性能我又不指望你在实时对话的时候给我朗读一段拍子代码对话的体验还是更重要一些对跟他对话你真的有一种在跟

一个讲英语的人说话一样非常适合练习英语口语我被学校的外教未来的工作感到担忧好那么 AI 相关的新闻就是上面这些接下来是 AMD 发布了 RX9070 和 9070XT

AMD 现在把 AVIDIA 的这一套命名给超过去了就像他在 CPU 上对 intel 做的那样 RX 老黄叫 RTX 对一模一样这命名直接对标性能也是一样就是直接对标 9070 9070XT

价格定价很良心 9070 是 44999070XT 是 4999 并且我现在看京东上你是可以以不超过原价太多的价格买到 9070XT 的因为这次 AMD 没有出公版就 MCRP 价格的飞弓已经被抢光了但是一些相对高端一点的飞弓比如我看迅井有几款海外版的显卡

买 5699 其实也没有比 MSRP 高很夸张太多现在也可以买得到现在已经距离发售已经过去一天了还可以买得到这个供货量还是比 NV 强很多的我看那个迅井以迅井为例它这每一款显卡呢

都预定出去了 300 多张 400 多张的样子光是这一个厂商的放火量可能就比 NV50 系所有厂商的放火量加起来都还要多了我听说

50 系显卡 5090 在美国一个周可能就放几十张是就线下而且 NV 还有一定几率卖给你一张这个坏卡一个有缺陷的卡这个 ROP2 可能会缺少 AMD 的这个卡现在我看着还是很不错的然后实际的性能表现得要等

职业评测出来之后才能知道这次随着 9070 和 9070XT 一起发布的还有 AMD 新的基于深度学习的 FSR4 超分模型就 AMD 的演示来看性能还是很不错的这个演示指的是它几个月之前在 CES 上的演示那个时候 AMD 演示了一个神秘的 AMD Research Project 这个 AMD 研究项目

这个研究项目就是一个超分模型,跟此前非生物学习的手工调教 FSR3.1 相比有巨大的提升,它的水平大概能达到 NVIDIA 基于 CNN 模型的 DLSS 的程度。这个我觉得还是很够用的,唯一的问题在于目前支持的游戏比较少,目前首批只支持 30 款游戏。

然后后续的话会有额外 75 款游戏加入对 FSR4 的支持 AMD 现在做这个深度学习驱动的 FSR 我觉得是有点晚了那人家 NV 都已经出了好几代了但是感觉也没有晚太多因为 NV 虽然现在出了新一代的机器 Transform 模型的 DLSS

但是坦率地讲,这个 Transform 模型现在还是早期,性能和 CNN 模型只能说是互有胜负,并没有拉开特别显著的差距。IMD 现在入场也微失未晚,跟 NV 的模型打得有来有回,还是很不错的。唯一的问题在于,这个 FSR4 只支持这次新发布的 90 系显卡,

像之前 7900XT 7900XTX 就 7000 系的这些显卡是不支持的尽管 7000 系的卡也有圣诺学习的加速单元这就不清楚为什么 AMD 会有这样的限制是真的有硬件上的区别还是说他就想多卖一点 90 系卡这就不清楚了这次 FSR4 还开源吗

这个我也挺关心的,但我现在没有看到 AMD 说要开源的这个事情,也有可能我没看到。但是他连自家上一代显卡都不给用这个 FSR4,可能也就不会开源了。也是有可能的,AMD 此前 FSR 都是开源的。说到这个,AMD 这次首批支持的游戏,我看,哇,好多索尼游戏啊。

再联想到索尼前段时间 PS5 Pro,一个重磅功能就是 PSSSR,PSSSR,PSSR 这个超幅模型也是一个生动学习超幅模型有没有可能这个 FSR4 就是给 PC 用的 PSSR 呢?好像还不是

我看汽车的 Foundry 去对比了 PSSR 和 AMD Research Project 也就是 FSR4 的画面就 PSSR 它有一种特定的噪声就是无论是你的画面怎么样你的画面看起来都会有一点点噪点有这种特性而 FSR4 并没有这种特性所以这两个可能还不是同一个模型

然后下一条新闻是小米本周发布了小米 15 Ultra 和小米苏 7 Ultra 小米这次叫双 Ultra 发布会小米 15 Ultra 看上去比较常规例行升级摄像头模组这些有一定的更新然后小龙 8 Elite 就这样了不过这可能是小米最后一次 6499 洗售了

之后可能要涨价要想比苏奇奥传就比较吸引人了它这是一个赛车给你下赛道跑圈用的动力非常的强劲并且价格并没有此前大家猜测的那么贵此前大家猜测说可能价格会在 80 万结果雷总说只要 50 万价格还比较的合适连夜说服高管然后我看很多人已经预定了

但是我又看到一些预定的博主去实际看了车之后觉得这个车虽然雷董在发布会上说豪华豪华豪华但是实际的质感可能还是 20 万的车的质感他的钱可能都花在动力系统上了确实也比较的小米这个豪刚用在刀刃上

小米未发少而生好那么以上就是本周 WTR 的全部内容了我是周周我是彪彪我们下周再见拜拜拜拜