2025-01-29 | Hugging Face 宣布启动 Open-R1 项目开源复刻 DeepSeek-R1 模型

Hacker News

Deep Dive

- 谷歌开源 Pebble OS 代码

- 社区志愿者维护 Pebble 设备

- 部分专有代码被移除

Shownotes Transcript

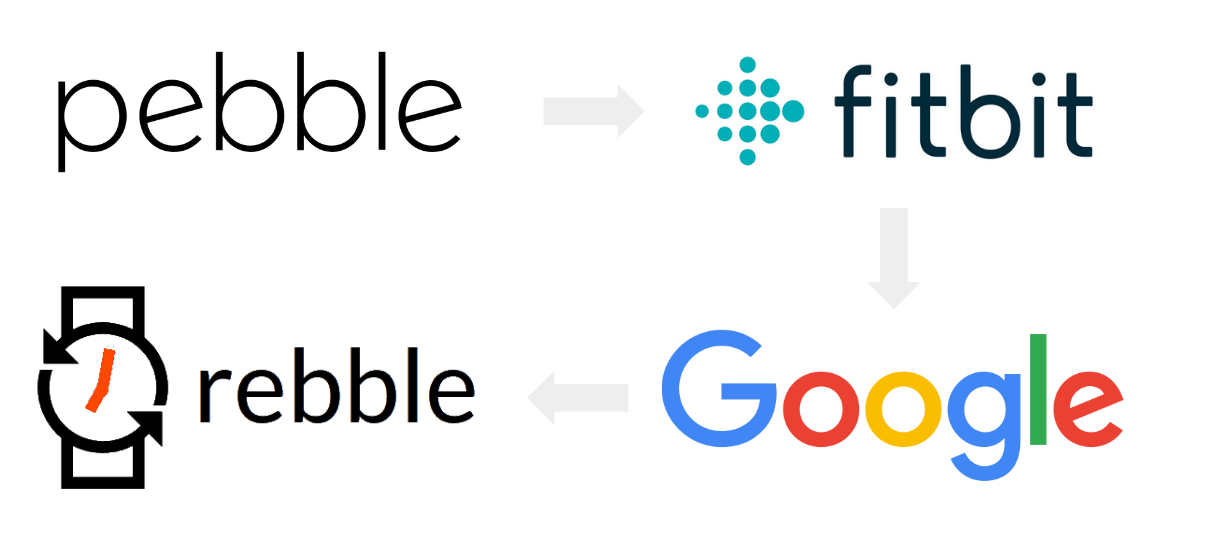

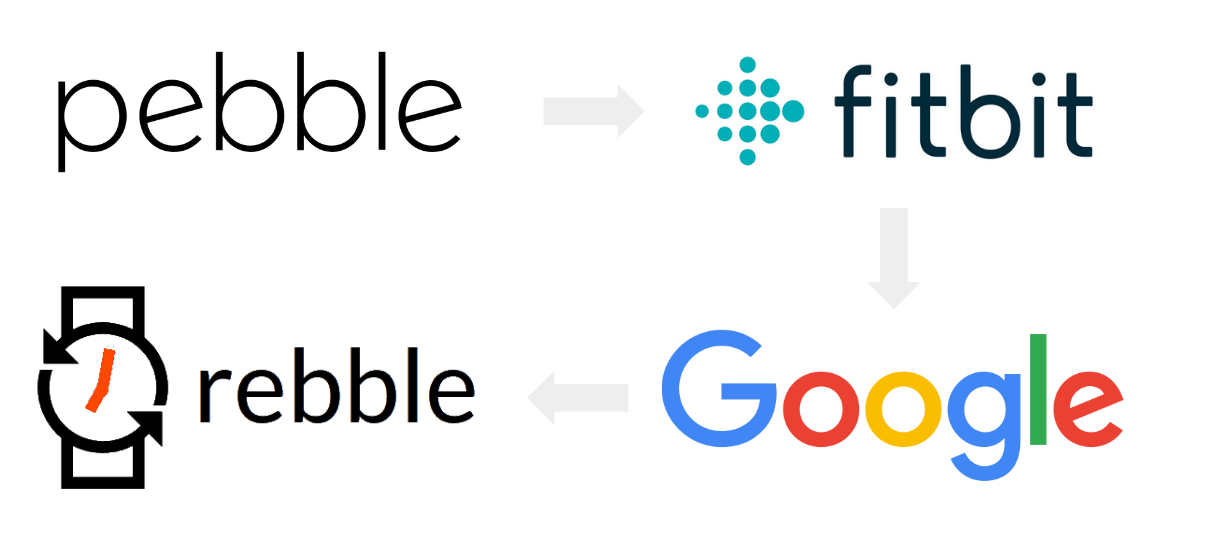

谷歌开源 Pebble 智能手表系统代码:复兴的曙光

谷歌宣布开源 Pebble 智能手表的操作系统代码,旨在支持社区和志愿者维护这款设备。虽然开源版本中去除了部分专有代码,但这为旧设备的开发和维护带来了新的可能性。希望这次开放,能够促使曾热爱 Pebble 的用户和开发者携手,为这款不再生产的设备带来新的生命。

文章链接:Google Open-sources the Pebble OS)

HN 链接: Hacker News)

Facebook 禁止讨论 Linux:为何绿色代码成为“安全威胁”

不久前,Facebook 宣布限制用户讨论 Linux,理由是此类内容被标记为“网络安全威胁”。 此举立即引起了广泛讨论和争议。用户发现,他们即便在尝试分享关于 Linux 的基础链接后,也会遇到帖子被审查或移除的情况。这一惊人决定在信息安全界引发了不同的解读,有观点认为这可能是误报造成的乌龙事件。讽刺的是,Linux 本身广泛应用于 Facebook 的基础设施。

文章链接: Facebook ban on discussing Linux?)

HN 链接: Hacker News讨论)

Dynamic 量化的革命:DeepSeek-R1 大大降低模型规格

DeepSeek-R1 模型通过动态量化技术实现了令人惊叹的 80% 大小缩减,带来了一种以 1.58-bit 运行的版本,不仅缩小至 131GB,而且在性能上有显著表现。这一优化让更多用户能够以较低的硬件配置试验大型模型,同时也为小型团队提供了用本地应用支持低延迟代理的机会。但批评者则认为,其在速度和重复性问题上仍有挑战,尤其在过于简单的量化处理下可能产生无限循环。不过,将选定层保留为高精度并采用混合专家(MoEs)的方法被认为是非常巧妙的设计。

文章链接: Run DeepSeek R1 Dynamic 1.58-bit)

HN 链接: Hacker News 讨论链接)

Nvidia 深度追踪:股市历史上最大抛售事件

在全球最大公司中, Nvidia 公司因投资者对中国 AI 初创公司 DeepSeek 的担忧,引发股价暴跌,市值蒸发创纪录的 5890 亿美元。 DeepSeek 的低成本模式引发了市场对巨头投入过多资金于 AI 开发的担忧,展示了与 OpenAI 及 Meta 不相上下的性能却价格远低。

文章链接: Nvidia’s $589 Billion DeepSeek Rout Is Largest in Market History)HN 链接: Hacker News)

新AI模型突破:揭示 DeepSeek-R1 的独特之处

DeepSeek-R1 是最近 AI 发展的重要节点,引起了机器学习研发社区的广泛关注。这个模型开源了权重,并且提供了精简版本,同时它还反映了一种可以重现类似 OpenAI O1 的推理模型的训练方法。这使得 DeepSeek-R1 在解决数学和推理问题方面表现出色,其独特之处在于生成解释其思维链的思维标记。

原文链接: The Illustrated DeepSeek-R1)HN 链接: Hacker News 讨论)

探索真实世界的机器学习生产化——打破模型演示的局限

卡耐基梅隆大学最新开设的课程“Machine Learning in Production”以其前沿的MLOps技术和实际应用深受关注。课程不仅教授模型的构建,更重视其在生产环境中的实际部署和维护。课程采用Kafka、Docker、Kubernetes等行业标准工具,还探讨了模型的解释性、公平性和监控的重要性。然而,一些评论者认为课程内容较为初级,对大规模网络训练的优化和推断管理关注不够。

文章链接: Machine Learning in Production (CMU Course))HN 链接: Hacker News Discussion)

Rebble 的未来:开源助力新征程

在 Google 开源 Pebble 操作系统的背景下,Rebble 宣布一系列发展计划,准备加速生产新硬件。Rebble 社区将转型为非盈利组织,以便更好地实现其开放平台的长期愿景,同时宣布即将开展 RebbleOS 黑客松活动。众多开发者和 Pebble 爱好者对此感到兴奋,并期待这一新的软件和硬件发展将如何影响智能手表市场。

原文链接: The future of Rebble)HN 链接: Hacker News Discussion)

开放原始模型 R1:开源复刻 DeepSeek-R1 的全新尝试

在最近的一篇博客中,谷歌开源 Pebble 智能手表系统代码:复兴的曙光

谷歌宣布开源 Pebble 智能手表的操作系统代码,旨在支持社区和志愿者维护这款设备。虽然开源版本中去除了部分专有代码,但这为旧设备的开发和维护带来了新的可能性。希望这次开放,能够促使曾热爱 Pebble 的用户和开发者携手,为这款不再生产的设备带来新的生命。

文章链接:Google Open-sources the Pebble OS)

HN 链接: Hacker News)

Facebook 禁止讨论 Linux:为何绿色代码成为“安全威胁”

不久前,Facebook 宣布限制用户讨论 Linux,理由是此类内容被标记为“网络安全威胁”。 此举立即引起了广泛讨论和争议。用户发现,他们即便在尝试分享关于 Linux 的基础链接后,也会遇到帖子被审查或移除的情况。这一惊人决定在信息安全界引发了不同的解读,有观点认为这可能是误报造成的乌龙事件。讽刺的是,Linux 本身广泛应用于 Facebook 的基础设施。

文章链接: Facebook ban on discussing Linux?)

HN 链接: Hacker News讨论)

Dynamic 量化的革命:DeepSeek-R1 大大降低模型规格

DeepSeek-R1 模型通过动态量化技术实现了令人惊叹的 80% 大小缩减,带来了一种以 1.58-bit 运行的版本,不仅缩小至 131GB,而且在性能上有显著表现。这一优化让更多用户能够以较低的硬件配置试验大型模型,同时也为小型团队提供了用本地应用支持低延迟代理的机会。但批评者则认为,其在速度和重复性问题上仍有挑战,尤其在过于简单的量化处理下可能产生无限循环。不过,将选定层保留为高精度并采用混合专家(MoEs)的方法被认为是非常巧妙的设计。

文章链接: Run DeepSeek R1 Dynamic 1.58-bit)

HN 链接: Hacker News 讨论链接)

Nvidia 深度追踪:股市历史上最大抛售事件

在全球最大公司中, Nvidia 公司因投资者对中国 AI 初创公司 DeepSeek 的担忧,引发股价暴跌,市值蒸发创纪录的 5890 亿美元。 DeepSeek 的低成本模式引发了市场对巨头投入过多资金于 AI 开发的担忧,展示了与 OpenAI 及 Meta 不相上下的性能却价格远低。

文章链接: Nvidia’s $589 Billion DeepSeek Rout Is Largest in Market History)HN 链接: Hacker News)

新AI模型突破:揭示 DeepSeek-R1 的独特之处

DeepSeek-R1 是最近 AI 发展的重要节点,引起了机器学习研发社区的广泛关注。这个模型开源了权重,并且提供了精简版本,同时它还反映了一种可以重现类似 OpenAI O1 的推理模型的训练方法。这使得 DeepSeek-R1 在解决数学和推理问题方面表现出色,其独特之处在于生成解释其思维链的思维标记。

原文链接: The Illustrated DeepSeek-R1)HN 链接: Hacker News 讨论)

探索真实世界的机器学习生产化——打破模型演示的局限

卡耐基梅隆大学最新开设的课程“Machine Learning in Production”以其前沿的MLOps技术和实际应用深受关注。课程不仅教授模型的构建,更重视其在生产环境中的实际部署和维护。课程采用Kafka、Docker、Kubernetes等行业标准工具,还探讨了模型的解释性、公平性和监控的重要性。然而,一些评论者认为课程内容较为初级,对大规模网络训练的优化和推断管理关注不够。

文章链接: Machine Learning in Production (CMU Course))HN 链接: Hacker News Discussion)

Rebble 的未来:开源助力新征程

在 Google 开源 Pebble 操作系统的背景下,Rebble 宣布一系列发展计划,准备加速生产新硬件。Rebble 社区将转型为非盈利组织,以便更好地实现其开放平台的长期愿景,同时宣布即将开展 RebbleOS 黑客松活动。众多开发者和 Pebble 爱好者对此感到兴奋,并期待这一新的软件和硬件发展将如何影响智能手表市场。

原文链接: The future of Rebble)HN 链接: Hacker News Discussion)

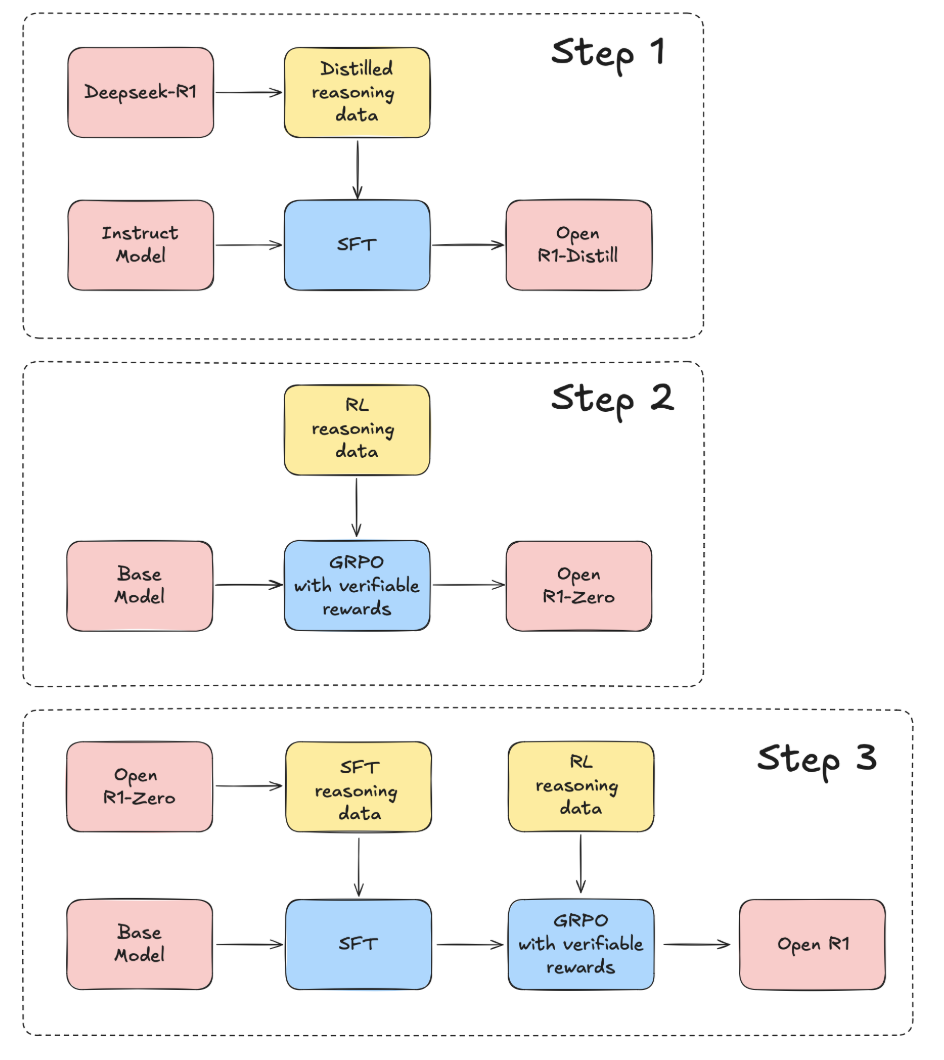

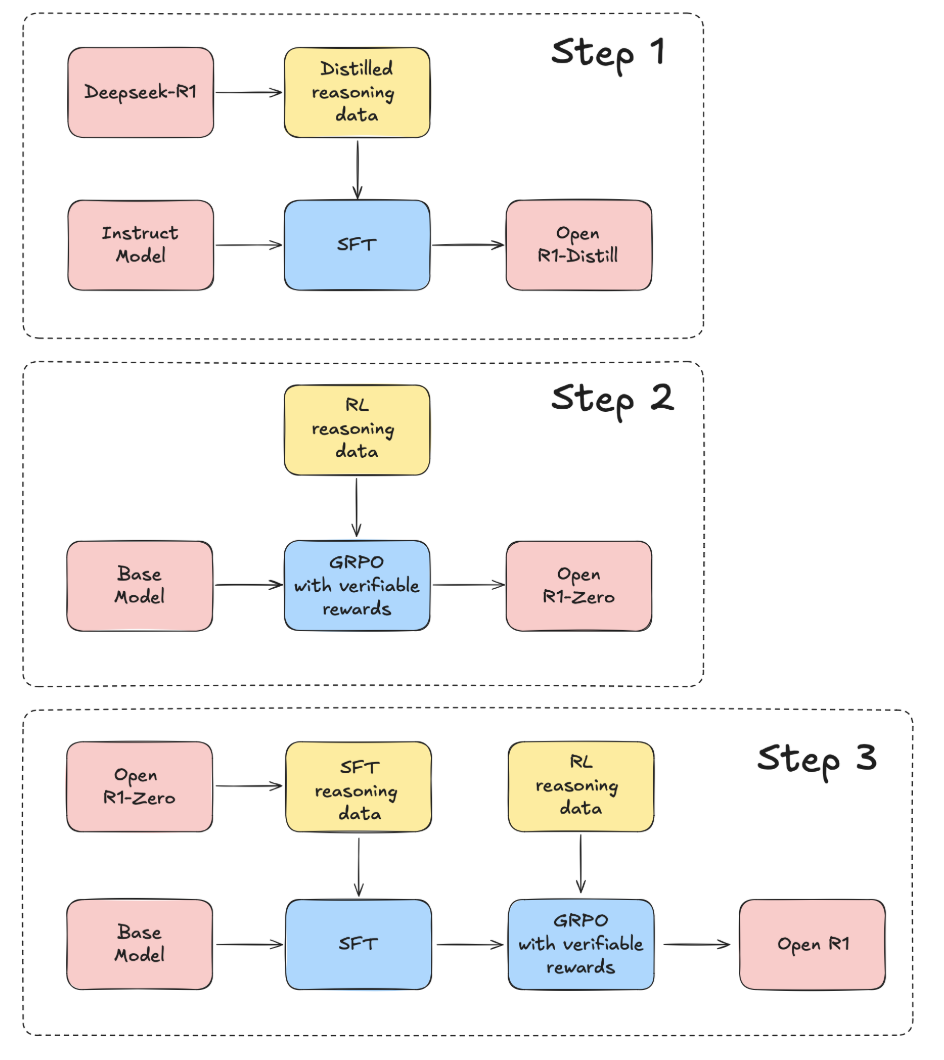

开放原始模型 R1:开源复刻 DeepSeek-R1 的全新尝试

在最近的一篇博客中,Hugging Face 宣布启动 Open-R1 项目,旨在完全开源复刻 DeepSeek-R1 模型。尽管该项目已开放了模型权重,但仍缺乏数据集和训练代码,引发了社区的广泛关注和讨论。评论者们对开源模型的透明性、数据集的获取以及训练流程的开放性提出了许多问题与建议。

文章链接:Open-R1: an open reproduction of DeepSeek-R1)HN 链接: Hacker News讨论页)

使用 Zopfli 缩减 NPM 的失败尝试,努力虽败犹荣

在尝试使用 Zopfli 压缩器减少 NPM 包体积 5% 的过程中,作者尽管最终未能如愿,但提供了详细回顾和见解。响应者指出,这项优化虽然在技术上可行,但并未获得足够的支持与认同。不过,该提案过程为作者提供了宝贵的经验。

原文链接: My failed attempt to shrink all NPM packages by 5%)HN 链接: Hacker News)

。尽管该项目已开放了模型权重,但仍缺乏数据集和训练代码,引发了社区的广泛关注和讨论。评论者们对开源模型的透明性、数据集的获取以及训练流程的开放性提出了许多问题与建议。

文章链接:Open-R1: an open reproduction of DeepSeek-R1)HN 链接: Hacker News讨论页)

使用 Zopfli 缩减 NPM 的失败尝试,努力虽败犹荣

在尝试使用 Zopfli 压缩器减少 NPM 包体积 5% 的过程中,作者尽管最终未能如愿,但提供了详细回顾和见解。响应者指出,这项优化虽然在技术上可行,但并未获得足够的支持与认同。不过,该提案过程为作者提供了宝贵的经验。

原文链接: My failed attempt to shrink all NPM packages by 5%)HN 链接: Hacker News)