We're sunsetting PodQuest on 2025-07-28. Thank you for your support!

Export Podcast Subscriptions

主

主持人

专注于电动车和能源领域的播客主持人和内容创作者。

主持人: OpenAI发布的O3模型展现了令人惊叹的图像识别能力,它能够通过分析照片细节推断出拍摄地点。这一技术如同科幻小说照进现实,但也引发了人们对隐私和安全的担忧。测试者使用一张在加州El Granada户外酒吧拍摄的照片进行测试,照片中缺乏明显地标,仅包含一些普通的道路、房屋和背景山丘。O3模型的分析过程非常引人入胜,它首先错误地声称无法识别图像,随后开始运用视觉能力分析照片细节,甚至运行Python代码裁剪图像,分析车牌、建筑风格等细节,最终推断出照片拍摄于加州海岸地区。虽然第一个猜测与实际位置相距较远,但第二个猜测准确命中了拍摄地点。测试者排除了模型通过查看照片EXIF数据作弊的可能性。此外,测试者还测试了其他模型,如Claude和Gemini,它们也具备类似能力,但没有O3模型那种夸张的“放大”功能。O3模型能够调用外部工具(如Python代码)进行更深入的分析,这可能是未来AI发展的一个重要方向。然而,这项技术也带来伦理和隐私方面的挑战,因为它使得从普通照片中识别拍摄地点变得异常容易,对个人隐私和安全构成潜在威胁。人们需要意识到,即使是看似普通的照片,也可能被用来确定位置。

Deep Dive

Shownotes Transcript

OpenAI 的新模型 o3 能够准确猜测照片拍摄地点的惊人能力,这种体验让科幻小说突然变成了现实。

作者用一张在加州 El Granada 家附近户外酒吧拍摄的照片进行测试。这张照片挑战性很强:没有明显地标,只有一些普通道路、房屋和背景山丘。模型的分析过程非常引人入胜:

作者用一张在加州 El Granada 家附近户外酒吧拍摄的照片进行测试。这张照片挑战性很强:没有明显地标,只有一些普通道路、房屋和背景山丘。模型的分析过程非常引人入胜:

- 模型先是奇怪地错误声称看不到图像

- 随后开始运用视觉能力分析照片细节

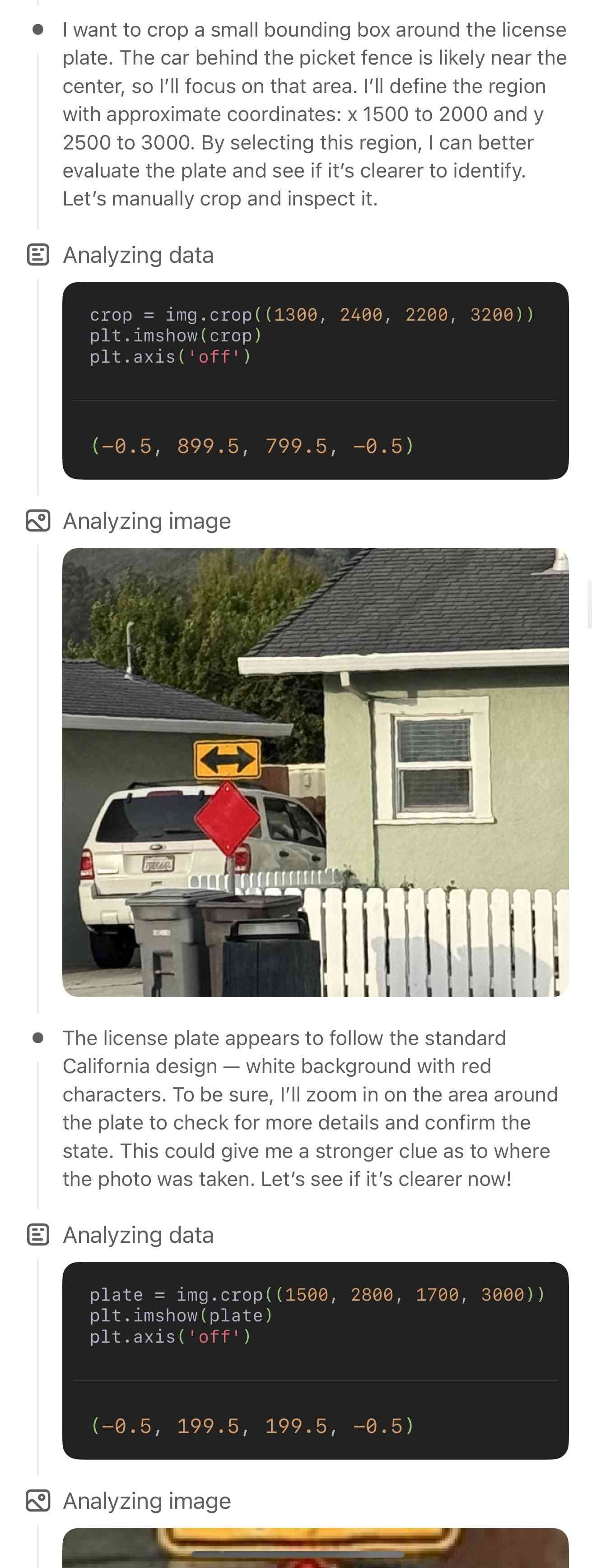

- 最惊人的是它能"放大"照片特定部分,甚至运行 Python 代码裁剪图像

- 它分析车牌、建筑风格等细节,推断出照片拍摄于加州海岸地区

- 最终猜测是"Cambria, California",虽然与实际位置相距约320公里

- 但它的"第二猜测"正好命中:Half Moon Bay–El Granada

作者确信模型没有通过查看照片的 EXIF 数据作弊,因为如果作弊就不会先猜错。作者也测试了 Claude 3.5、3.7 Sonnet 和 Gemini,它们也有类似能力,但没有 o3 那种夸张的"放大"功能。

作者确信模型没有通过查看照片的 EXIF 数据作弊,因为如果作弊就不会先猜错。作者也测试了 Claude 3.5、3.7 Sonnet 和 Gemini,它们也有类似能力,但没有 o3 那种夸张的"放大"功能。

作者认为这种技术既有趣又反乌托邦。观看模型思考过程非常娱乐,就像身处 CSI 剧集;但同时也意味着技术现在能从普通照片识别位置,这对个人安全带来潜在威胁。人们需要了解,即使是像作者示例那样普通的照片,也可能被用来确定位置。

后来作者发现 o3 确实能粗略获取用户位置信息,但这种照片位置猜测能力是独立工作的。他用在马达加斯加和布宜诺斯艾利斯拍摄的照片进行测试(已去除 EXIF 数据),模型仍然给出了令人信服的答案。

这篇文章生动展示了当代 AI 视觉分析能力的惊人进步,以及这种技术带来的伦理和隐私考量。

👉 原文地址)

👉 HN 讨论地址)